Неможливо заперечувати зростання впливу технологій штучного інтелекту на наше суспільство за останні роки. Оскільки все більше і більше додатків для смартфонів, smart companions та пристроїв використовують штучний інтелект, як-от Cortana та Siri, регулюючі органи ЄС вирішили зайняти тверду позицію в цьому питанні.

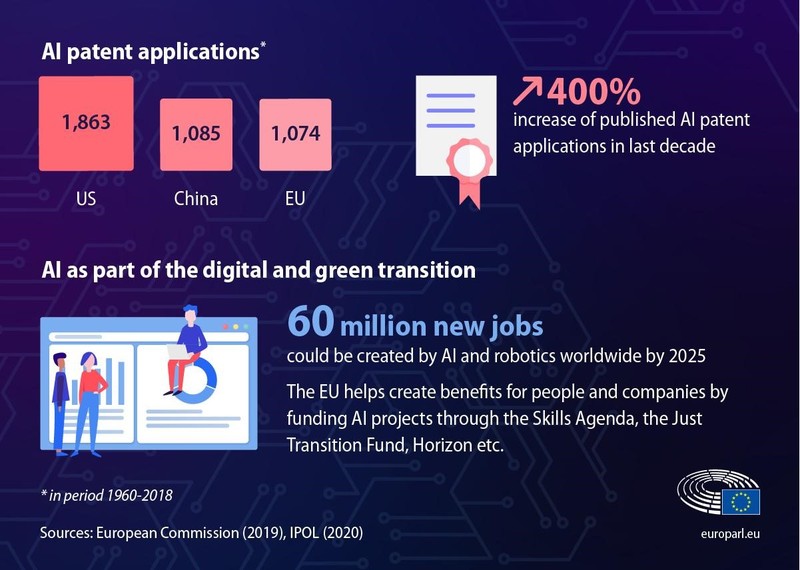

Згідно з висновками Європейського парламенту, до кінця 2025 року завдяки штучному інтелекту та робототехніці може бути створено 60 мільйонів нових робочих місць. У тому ж звіті вказується, що за останнє десятиліття кількість опублікованих патентів на штучний інтелект зросла на 400% у порівнянні з минулими періодами. У зв’язку з таким зростанням впровадження та популярності штучного інтелекту, Європейський парламент вирішив внести законопроєкт, який буде визначати порядок використання штучного інтелекту.

Подібно GDPR, цей новий законопроєкт має на меті пояснити, як можна, а як не можна використовувати штучний інтелект на території ЄС. Хоча деяким компаніям та керівникам це може здатися радикальним, це необхідний крок до регулювання технологій штучного інтелекту в майбутньому. Що саме передбачає це регулювання та як це вплине на бізнес в ЄС і за його межами?

Етика впровадження штучного інтелекту

Найважливішою сферою цього законопроєкт є питання етики використання штучного інтелекту в повсякденному житті. Занепокоєння законодавців зводяться до того, що штучний інтелект не може компенсувати людську логіку, хоча в деяких випадках він є надзвичайно компетентний та корисний.

Впровадження штучного інтелекту в охороні здоров’я, науці, дослідженнях та інших важливих галузях може бути корисним у короткостроковій перспективі, але шкідливим у довгостроковій перспективі. Штучний інтелект може завадити дослідникам та медичним експертам, а не допомогти, оскільки він автоматизує велику частину їхньої роботи. Занепокоєння законодавців також поширюється на той факт, що штучний інтелект потенційно може знищити робочі місця в результаті високої обчислювальної потужності та автоматизації.

У той час як робочі місця, пов’язані зі штучним інтелектом, з’являться в результаті його все більшого застосування, інші зникнуть, наче їх ніколи та не було. Першим кроком до регулювання штучного інтелекту в майбутньому буде розподілу використання штучного інтелекту на три категорії та пояснення того, як слід розглядати кожну з них.

Розподіл трьох етапів ризику штучного інтелекту

Щоб уникнути зведення штучного інтелекту до однієї групи, законодавці ЄС вирішили виділити три окремі рівні «ризику імплантації». Названі «низьким», «високим» та «неприйнятним», ці етапи ризику мають використовуватися підприємствами та науково-дослідними установами як орієнтири в майбутньому.

Цей закон передбачає дозволити використовувати алгоритми штучного інтелекту з низьким рівнем ризику, як це було раніше, в основному для автоматизації. Однак штучний інтелект з високим та неприйнятним ризиком потребуватиме додаткових дозволів з ретельним контролем при впровадженні в ЄС. Це вже викликало негативну реакцію з боку багатьох компаній у ЄС та поза його межами, оскільки заважає стабільному прогресу. Як саме виглядає кожен із цих етапів ризику на практиці?

-

Низький ризик

Впровадження штучного інтелекту з низьким рівнем ризику в ЄС направлено на регулювання систем штучного інтелекту, таких як чат-боти та персональні помічники. Бренди повинні повідомляти своїх користувачів, коли вони не розмовляють напряму з людиною.

Це крок на користь споживачів, який полегшить людям взаємодію з брендами в Інтернеті. Він забезпечує більш прозорі та надійні відносини B2C. Однак ще невідомо, наскільки добре підприємства дотримуватимуться цих правил, оскільки вони будуть обов’язковими для будь-якого бізнесу, що працює в ЄС.

-

Високий ризик

Системи високого ризику – це системи, які потенційно можуть порушити фінансове, фізичне або психічне благополуччя користувача. У цьому випадку найбільше постраждають фінансові установи з високим рівнем автоматизації. Штучний інтелект, який використовується для перевірки, індексації та аналізу даних користувачів, часто навіть без відому самого користувача, повинен стати транспарентним.

Це значно ускладнить підприємствам можливість використання високотехнологічного штучного інтелекту для аналізу даних та орієнтування на клієнтів без явної згоди користувачів. Знову ж таки, на перший погляд, цей крок Європейського парламенту здається на користь користувачів, але його результати поки що залишаються невизначеними.

-

Неприйнятний ризик

Система соціального рейтингу Китаю була в центрі суперечок на Заході протягом багатьох років, саме тому регулювання штучного інтелекту зараз активно просувається. Штучний інтелект, що представляє неприйнятний ризик, це той, який сприймає своїх користувачів за дані, які підлягають аналізу. Практичне застосування цих систем штучного інтелекту включає в себе публічні біометричні сканування, камери громадської безпеки з розпізнаванням обличчя та вищезгадані алгоритми соціального оцінювання.

Цей закон спрямований на максимальне скорочення дискримінаційних практик в соціальних групах по всій території ЄС. Хоча існують виключення, коли штучний інтелект все ще можна використовувати для пошуку зниклих безвісти або допомоги у розкритті злочинів у ЄС. Однак, коли справа доходить до щоденного застосування штучного інтелекту з не прийнятним ризиком, корпоративні структури не зможуть отримати ліцензію на його вільне застосування.

Закон, розроблений ЄС, не завершений та не позбавлений недоліків. На перший погляд, він є дуже обмежувальним, і в майбутньому значно ускладнить розробку штучного інтелекту через бюрократію та паперову тяганину. З іншого боку, він перешкоджатиме нерегульованому використанню штучного інтелекту для будь-якої корпорації, яка працює в ЄС. Однак, поки правила не будуть повністю допрацьовані, підприємства будуть стикатися з проблемою потенційного порушення правил, не усвідомлюючи про їх порушення.

Правила ЄС щодо штучного інтелекту за межами ЄС

На відміну від GDPR, закон про штучний інтелект стосується не лише громадян ЄС. Натомість будь-який бізнес, який має намір продавати продукцію або працювати в ЄС, повинен буде відповідати новим правилам. Незалежно від того, чи знаходиться компанія в США, Азії чи Великобританії, їй доведеться беззаперечно відповідати новим стандартам.

Це створить додаткові проблеми для британських фірм та компаній, які відповідали вимогам ЄС протягом багатьох років до того як стався Brexit. Оскільки розвиток штучного інтелекту швидко просувається вперед, відповідність встановленим нормам може стати проблемою залежно від того, наскільки далеко просунулися ці системи.

Що станеться з інноваційними, революційними новими технологіями штучного інтелекту, які тепер визнані парламентом неприйнятними або високоризикованими? Чи загрожують їм високі штрафи та потенційна конфіскація чи обов’язкове видалення технології через її невідповідність новим стандартам ЄС? Лише час покаже, чи залишиться якась «сіра зона» та як будуть відноситись до існуючих проектів.

Корпоративне VS Академічне впровадження закону про штучний інтелект

Ми розглянули, як нові правила штучного інтелекту вплинуть на корпоративні структури та підприємства, орієнтовані на розвиток штучного інтелекту. Проте в подальшому академічні дослідницькі галузі не відповідатимуть тим самим стандартам, що діють в ЄС.

Університети, дослідницькі центри та лабораторії підпадають під інший набір правил щодо штучного інтелекту, оскільки вони зосереджені на прогресі в контрольованому середовищі. Однак це також викликає певні занепокоєння. Що означає академічний розвиток штучного інтелекту згідно з новим законом про штучний інтелект? Системи штучного інтелекту, що на перший погляд здаються нешкідливими, можуть перетворитися на щось зловмисне та в подальшому підлягатимуть цензурі зі сторони ЄС.

Лише час покаже, як це буде регулюватися порівняно з впровадженням штучного інтелекту на корпоративному рівні. Факт залишається фактом, штрафи, пов’язані з законом про штучний інтелект, мають той самий рівень серйозності, що й штрафи передбачені GDPR. Підприємства та корпоративні структури, які не дотримуватимуться правил, зіткнуться з штрафами та санкціями з боку ЄС.

Що чекає штучний інтелект в ЄС в майбутньому? (Висновок)

Єдиний шлях для бізнесу, який має намір працювати в ЄС, – це почати виконувати ці правила як раніше. Модель, запропонована Європарламентом, надійна, але не безпомилкова. Якщо порівнювати з GDPR то в наступні роки ЄС продовжить удосконалювати та коригувати свій закон щодо штучного інтелекту.

Однією з областей, яка не піддається сумніву, є реакція користувачів на цей закон. Кінцеві споживачі та звичайні люди будуть задоволені законом про штучний інтелект, тому що він відповідає їхнім інтересам. Знання того, коли і як ви взаємодієте з штучним інтелектом публічно чи онлайн – це те, що багато хто вважатиме за звичайну ввічливість.

Залишається відкрите питання, чому підприємства так прагнуть зберегти цей факт в секреті. Зрештою, бізнесом керують люди, і без регульованого використання штучного інтелекту, ми ризикуємо, що технологія стане неприборканою. Якщо це станеться, буде важко керувати корпораціями, які використовують штучний інтелект без будь-яких форм регулювання. З цієї точки зору, правила ЄС в області штучного інтелекту є позитивним фактором для всіх.